什么是多线程爬虫?多线程爬虫通过多个线程并行下载和处理网页内容,提高爬取效率,尤其适用于大规模网站。如何构建多线程爬虫:创建线程池管理请求队列解析和处理页面监控爬取过程优点:更快的爬取速度提高效率处理大网站的能力缺点:潜在的线程安全问题复杂的实现和管理可能增加内存消耗

Java 多线程爬虫教程

什么是多线程爬虫?

多线程爬虫是一种利用多个线程同时下载和处理网页内容的爬虫技术。它可以大幅提高爬取效率,尤其是在处理大规模的网站时。

为什么使用多线程爬虫?

立即学习“Java免费学习笔记(深入)”;

- 更快的爬取速度:多个线程并行工作,可以同时下载和处理多个页面,从而加速爬取过程。

- 提高效率:并行处理可以充分利用 CPU 资源,最大化爬虫的效率。

- 处理大网站:对于大型网站,多线程爬虫可以有效管理大量的请求和响应,避免单线程爬虫的瓶颈。

如何构建多线程爬虫?

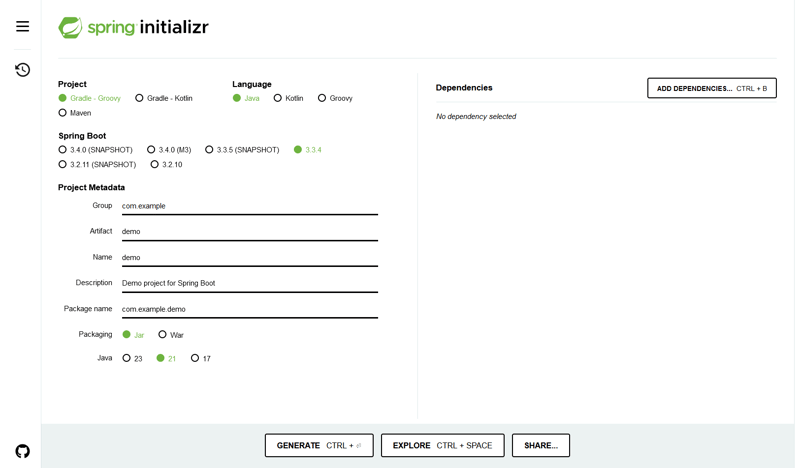

构建一个 Java 多线程爬虫需要以下步骤:

- 创建线程池:创建一组线程来处理下载和处理请求。线程池的大小取决于网站的规模和所需的爬取速度。

- 管理请求队列:使用队列管理需要爬取的 URL。线程从队列中获取 URL 并下载相应的页面。

- 解析和处理页面:下载的页面将被解析和处理,提取所需的数据并将其存储到数据库或其他存储机制中。

- 监控爬取过程:使用监控机制来跟踪爬取进度,检测错误和进行必要的调整。

示例代码:

// 创建线程池

ExecutorService executorService = Executors.newFixedThreadPool(10);

// 创建请求队列

BlockingQueue<string> urlQueue = new LinkedBlockingQueue();

// 爬虫主线程

public static void main(String[] args) {

// 初始化 URL 队列

urlQueue.addAll(Arrays.asList("url1", "url2", "url3"));

// 提交任务到线程池

for (String url : urlQueue) {

executorService.submit(new CrawlerTask(url, urlQueue));

}

// 等待任务完成

executorService.shutdown();

executorService.awaitTermination(1, TimeUnit.HOURS);

}

// 爬虫任务

public static class CrawlerTask implements Callable<void> {

private String url;

private BlockingQueue<string> urlQueue;

public CrawlerTask(String url, BlockingQueue<string> urlQueue) {

this.url = url;

this.urlQueue = urlQueue;

}

@Override

public Void call() throws Exception {

// 下载页面

String pageContent = downloadPage(url);

// 解析页面

List<string> newUrls = parsePage(pageContent);

// 将新 URL 添加到队列

urlQueue.addAll(newUrls);

// 处理页面数据

processPageData(pageContent);

return null;

}

}</string></string></string></void></string>

优点和缺点

优点:

- 更高的爬取速度

- 提高效率

- 处理大网站的能力

缺点:

- 潜在的线程安全问题

- 复杂的实现和管理

- 可能增加内存消耗

以上就是java多线程爬虫教程的详细内容,更多请关注php中文网其它相关文章!

版权声明:本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系 yyfuon@163.com