使用 java 自动爬取网页的步骤:选择 web 爬虫库(如 jsoup 或 selenium)。建立网络客户端以向目标网站发送请求。解析 html 响应并提取所需数据。将提取的数据存储到数据库或文件中。

Java 自动爬虫教程

简介

在当今数据驱动的时代,自动网络爬取(又称网络蜘蛛)已成为获取大量信息和数据的重要技术。Java 是开发爬虫程序的热门语言,因其强大、跨平台和开源特性而备受追捧。

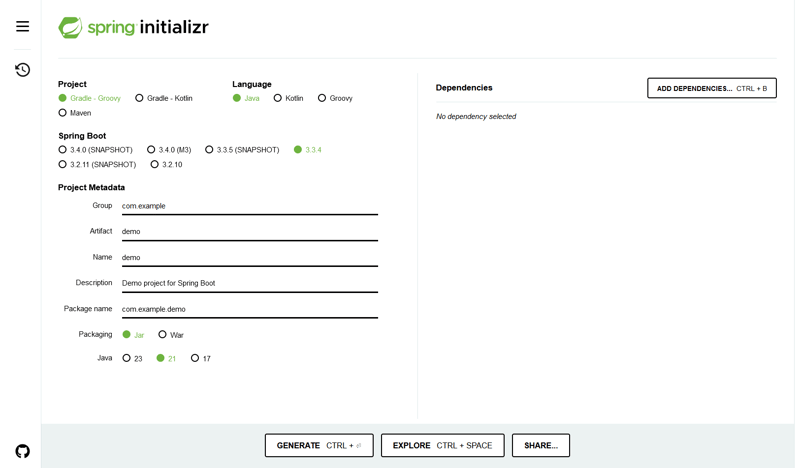

所需工具

在开始之前,你需要准备以下工具:

- Java 开发环境 (JDK)

- Web 爬虫库(如 Jsoup、Selenium)

- 文本编辑器或 IDE(如 Visual Studio Code、Eclipse)

步骤

- 选择一个 Web 爬虫库:Jsoup 和 Selenium 是流行的 Java 爬虫库。Jsoup 适用于解析 HTML 文档,而 Selenium 提供无头浏览器功能,可以模拟人类浏览。

- 建立网络客户端:使用 java.net 包创建 HttpURLConnection 对象,用于向目标网站发送请求。

- 解析响应:使用 Jsoup 解析 HTML 响应,或使用 Selenium 导航爬取动态页面。

- 提取数据:从解析后的文档中提取所需数据,如文本、图像或链接。

- 存储数据:将提取的数据存储到数据库、文件或其他数据存储中。

示例代码

以下示例代码使用 Jsoup 爬取网页的标题:

import org.jsoup.Jsoup;

import java.io.IOException;

public class Crawler {

public static void main(String[] args) throws IOException {

String url = "https://www.example.com";

org.jsoup.nodes.Document doc = Jsoup.connect(url).get();

String title = doc.title();

System.out.println(title);

}

}

注意事项

- 遵守 robots.txt 协议:遵守网站的 robots.txt 协议,以避免爬取未经授权的页面。

- 限制爬取速率:通过在请求之间引入延迟来限制你的爬取速率,以避免服务器过载。

- 处理重定向和错误:使用重试机制处理重定向和 HTTP 错误,确保你的爬虫程序稳定运行。

- 尊重隐私:仅爬取公开可用的数据,并遵守网站的隐私政策。

以上就是java自动爬虫教程的详细内容,更多请关注php中文网其它相关文章!

版权声明:本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系 yyfuon@163.com